新型生成AI「Claude Mythos(クロード・ミュトス)」が話題になっている理由

最近、アメリカのアンソロピックが開発した「ミュトス(Mythos)」という新しいAIが話題になっています。

従来のAIといえば、文章を作ったり質問に答えたり、画像や動画を生成するものが中心でした。

例えば、OpenAI のChatGPTや、Google のAIなどです。

しかしミュトスは、それとは少し違います。

→「システムの弱点を見つける能力」に特化したAI

→しかも、その弱点をどう攻撃するかまで考えられる可能性がある

→そして、自律的に攻撃をすることができる

これが「危険ではないか?」と注目されている理由です。

ミュトスの何が危険なのか?

では、具体的にどこが問題なのでしょうか。

① サイバー攻撃能力が飛躍的に向上

ミュトスのようなAIは、人間では見つけられないレベルの脆弱性(セキュリティの穴)を発見できます。

これにより、

- OS

- Webサービス

- 金融システム

など、あらゆるデジタル基盤が影響を受ける可能性があります。

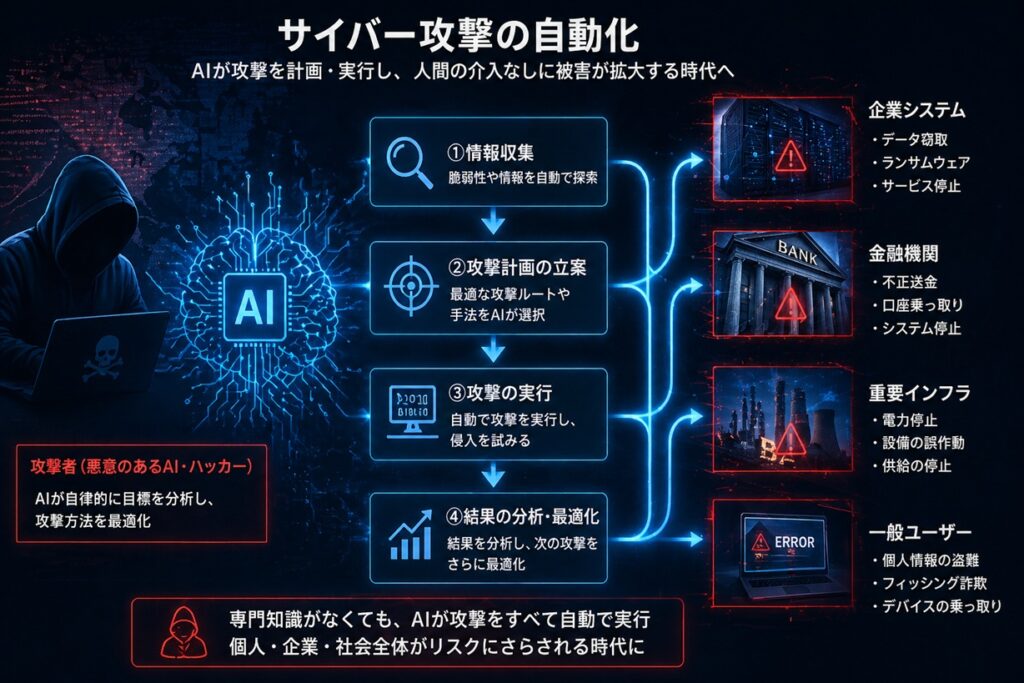

② 攻撃の自動化が現実になる

従来は高度なスキルが必要だったサイバー攻撃も、

→AIによって「自動化」される可能性があります

つまり、極端な話をすると、

→専門知識がなくても攻撃ができてしまう世界

が近づいているということです。

③ 社会インフラへの影響

現代社会はデジタルに依存しています。

- 電気

- 通信

- 金融

これらが攻撃されると、影響は個人レベルを超えます。

→国家レベルの問題になる可能性もある

■ 電気インフラの破壊例

① 大規模停電(都市全体が停止)

電力会社の制御システム(SCADA)が攻撃されると、発電や送電のバランスが崩れます。

その結果、

- 都市全体が停電

- 信号機停止 → 交通混乱

- 病院の機能低下

実際に、ウクライナ電力網サイバー攻撃では

数十万人規模が停電しました。

② 発電所の誤作動・停止

AIが制御プログラムを書き換えることで

- 発電停止

- 異常な負荷による設備損傷

→最悪の場合、復旧に数週間〜数ヶ月かかることも

③ 電力需給バランスの破壊

電力は「作る量=使う量」で調整されています。

→ここをAIが操作すると

- 突然の電力不足

- 強制的なブラックアウト

■ 通信インフラの破壊例

① インターネット遮断(全国レベル)

通信の中核(DNSやルーティング)が攻撃されると起こること

- Webサイトが見れない

- メール停止

- クラウド全滅

→仕事も日常も完全ストップ

② 携帯電話ネットワークの停止

基地局やコアネットワークが攻撃されると

- 通話不可

- SMS不可

- データ通信不可

→災害時なら致命的

③ 情報の改ざん・なりすまし

通信そのものが乗っ取られると

- 偽の情報を流す

- 本物のサイトに見せかける

→フィッシング詐欺が超高度化

■ 金融インフラの破壊例

① 銀行システム停止

銀行の基幹システムが攻撃されると起こること

- ATM使えない

- 振込できない

- 残高確認不可

→経済活動が止まる

② 不正送金の大量発生

AIがセキュリティの穴を突くと

- 口座から資金流出

- 複数口座に分散送金

→被害は一気に拡大

③ 株式市場の混乱

取引システムが操作されると

- 株価の異常変動

- 売買停止

→パニック売り → 世界経済に影響

※過去には フラッシュ・クラッシュ のように一瞬で市場が暴落した事例もあります。

例えば、2022年10月24日 ドル/円 約10分で約4円の変動があったなど。

フラッシュ・クラッシュ:金融市場で急激な価格変動が一瞬で発生し、その後、価格が変動前の水準に急速に回復する現象

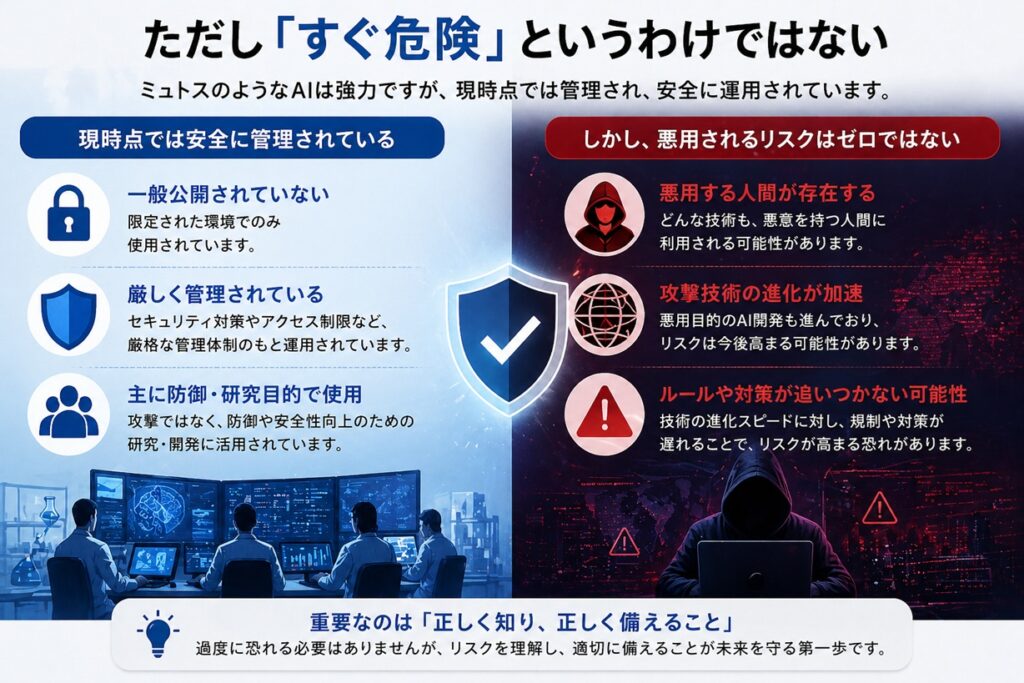

ただし「すぐ危険」というわけではない

ここは誤解されやすいポイントです。

ミュトスのようなAIは確かに強力ですが、現時点では

- 一般公開されていない

- 厳しく管理されている

- 主に防御・研究目的で使われている

という状況です。

また、ミュトスはアメリカのMicrosoftやAmazonなど、ハイテクや金融などの一部の企業に限定して公開、ソフトウエアの脆弱性を洗い出すプロジェクトがすでに立ち上がっています。

事前にミュトスでそれぞれの脆弱性を洗い出し、パッチをして穴を埋めておくことで、あらかじめ耐性を作っておき、防御力を高めておくということです。

ミュトスはどこで、どう使われているのか

ミュトスのような高度AIは、一般ユーザーが直接触れるサービスではなく、企業や政府の“裏側”のセキュリティ領域で活用されています。

その目的はシンプルで、「攻撃される前に弱点を見つけて潰す」ことです。

例えば、まず代表的なのがソフトウェア開発の現場です。

大手IT企業では、新しいアプリやシステムをリリースする前に、AIを使って「擬似的なサイバー攻撃」を行います。

従来は人間のセキュリティエンジニアが手作業で脆弱性を探していましたが、ミュトスのようなAIは、数万パターンの攻撃を一瞬で試すことができます。

これにより、

・SQLインジェクション

・認証の抜け穴

・想定外の入力によるバグ

といった問題を、リリース前に発見し、修正(パッチ適用)することが可能になります。

次に重要なのが、クラウドインフラの防御です。

MicrosoftやAmazonのような企業が提供するクラウドサービスは、世界中の企業の基盤になっています。

もしここに脆弱性があれば、影響は一企業では済まず、社会全体に広がります。

そのため、AIは

・不審なアクセスパターンの検知

・通常とは異なる通信のリアルタイム分析

・攻撃の予兆の自動判断

といった形で、24時間体制の監視役として機能しています。

特に重要なのは、「まだ起きていない攻撃」を予測する能力です。

過去の攻撃データや世界中のログを学習することで、「この動きは危険な前兆だ」と判断し、被害が出る前に遮断することができます。

さらに、金融システムの分野でも活用が進んでいます。

銀行や証券会社では、不正送金や不正取引を防ぐために、AIがリアルタイムで取引を監視しています。

例えば、

・普段とは異なる国からのログイン

・短時間での異常な資金移動

・人間では気づけない微妙なパターンの変化

といった挙動を検知し、自動でブロックやアラートを出します。

これも同様に、「被害が出てから対応する」のではなく、未然に防ぐ防御型の運用です。

また、最近では国家レベルのサイバー防衛にも応用されています。

重要インフラ(電力・通信・交通など)に対する攻撃を想定し、AIが仮想空間でシミュレーションを行い、どこが狙われやすいかを分析します。

これにより、現実のシステムに対して事前に対策を打つことが可能になります。

ポイントをまとめると、ミュトスの本質は「攻撃するAI」ではなく、“攻撃を先回りして防ぐAI” です。

つまり現時点では、

・攻撃側ではなく防御側で使われている

・公開されず、限られた環境で運用されている

・社会インフラを守るための技術として活用されている

というのが実態のようです。

■ 日本政府の対応

じゃあ、日本政府の対応はどうなっているのか?

大きく分けると3つあります。

① 官民連携で「AI防御ネットワーク」を作ろうとしている

日本では企業と政府が一体になった防御体制を構築する動きが出ています。

・金融機関

・IT企業

・インフラ企業

などが連携して、AIで脆弱性を先に見つけて潰す仕組みを作ろうとしています。

これは、アメリカの「Project Glasswing」に近い考え方です。

つまり、攻撃される前に“AIで先に攻撃して穴を見つける”

という完全に新しい防御思想です。

② 「能動的サイバー防御」にシフトしている

これがかなり重要で、日本はこれまで「攻撃されたら対応する」という受け身の対応でした。

でも今は「攻撃される前に検知・無害化する」方向に変化しています。

・事前に不審な通信を検知

・攻撃の兆候を早期に把握

・被害が出る前に止める

という形に変わっています。

実際に、法整備も進んでいる(能動的サイバー防御)

③ 日本版「ミュトス活用プロジェクト」を検討

さらに面白いのがこれ。

日本独自のAIセキュリティプロジェクト構想

具体的には

・政府内でAIを使って脆弱性を発見

・国内インフラの弱点を洗い出す

・攻撃耐性を事前に強化

いわば「守るためにAIを使う国家プロジェクト」が議論されています。

■ 重要なポイント

ここはかなり大事で、 日本政府は“AIを止める”方向では動いていない、ということです。

理由

・AIは止められない(海外で開発される)

・技術競争で遅れると逆に危険

・防御に使った方が現実的

つまり、「AI vs AI」で守る戦略に完全シフトしている、と言えます。

昔と今で戦っている構造が違う

今起きているのはこれ。

●昔:人間 vs 人間(ハッカー vs セキュリティ)

●今: AI vs AI(攻撃AI vs 防御AI)

■ 日本政府の対応まとめ

日本政府は、ミュトスのようなAIを単純に規制するのではなく、

AIを活用した防御体制の構築に舵を切っています。

具体的には、

・官民連携による防御ネットワーク

・能動的サイバー防御の導入

・AIによる脆弱性検出プロジェクト

などが進められており、

今後は「AI vs AI」の防御が主流になります。

つまりこれからの時代は、

AIを禁止するかではなく、AIをどう使って守るか

が国家レベルのテーマになっているのです。

本当の問題は「AI」ではなく「使う人間」

実は最も重要なのはここです。

→AIそのものより、人間の使い方がリスクになる

- 悪用する人がいるか

- ルールが整備されるか

これによって未来は大きく変わります。

「誰が・どのように使うか」です。

これは過去のあらゆる技術でも同じでした。

インターネットも、元々は軍事産業から出発した情報共有を目的としたものです。革新的な技術で平和的に利用されればとても便利なものとなりましたが、同時に詐欺やサイバー犯罪の温床にもなりました。

スマートフォンも生活を便利にする一方で、個人情報の流出や依存といった新たな問題を生み出しています。

AIも全く同じ構造です。

むしろ、これまでの技術よりも「影響力」と「スピード」が桁違いであるため、人間側の使い方がより強く問われる時代になっています。

まず大きなリスクは、「悪意ある利用者の存在」です。

どれだけ高度なAIでも、それ自体が勝手に犯罪を起こすわけではありません。

しかし、もし悪意を持った人間がAIを使えば、これまで人間単独では難しかった規模の攻撃が可能になります。

例えば、

・大量のフィッシングメールを自然な文章で自動生成する

・脆弱性を短時間で探索し、攻撃コードを作る

・偽情報を大量に拡散し、世論を操作する

といったことが、低コスト・短時間で実現できてしまいます。

つまり、「悪用する意思を持つ人間」がいる限り、リスクはゼロにはなりません。

次に重要なのが、「ルールと規制の整備」です。

技術の進化に対して、法律やガイドラインはどうしても後追いになりがちです。

AIの進化スピードは特に速く、現状では国や企業ごとに対応がバラバラで、統一されたルールが十分に整っているとは言えません。

この状態が続くと、

・規制の緩い国で危険な開発が進む

・責任の所在が曖昧になる

・企業間で安全性より競争が優先される

といった問題が起きやすくなります。

一方で、ルールが適切に整備されれば、状況は大きく変わります。

例えば、

・AIの利用範囲の明確化

・開発・運用時の監査体制

・悪用時の罰則強化

などが徹底されれば、リスクは大幅に抑えられます。

つまり未来は、

「AIが進化するかどうか」ではなく

「人間がそれをどうコントロールできるか」

によって決まるのです。

ポイントをまとめると、

・AIはあくまで“道具”であり、善にも悪にもなる

・最大のリスクは「悪用する人間の存在」

・ルール整備の遅れがリスクを拡大させる

・逆に言えば、人間次第で安全性は大きく高められる

ということです。

ミュトスが使えなくても、代替AIで攻撃が成立する可能性あり

ミュトスが危険だ!となって、ミュトスを制限したらいいでは?という話もあります。

これについては、ミュトスが使えなくても、代替となるAIで攻撃は成立する可能性は十分あります。

なぜ代替AIでも成立してしまうのか?

理由はシンプルで、AIは「特定の名前やモデル」が問題なのではなく、

“能力そのものが広がっている”からです。

現在のAIは一部の企業だけの専有技術ではなく、以下のように広がっています。

① オープンソースAIの存在

誰でもダウンロード・改良できるAIモデルが増えています。

これらを組み合わせることで、ある程度高度な処理は再現可能です。

つまり「ミュトスがなくても、似た機能は作れる」状態になりつつあります。

② AIの進化スピードが速すぎる

ここ半年でも体感している通り、性能の進化が非常に速いです。

今は制限されていても、数年後には「普通のAIでも同等レベル」になる可能性があります。

③ 攻撃は“最先端AI”である必要がない

ここは重要です。

実はサイバー攻撃は

「そこそこ賢いAI」で十分成立するケースが多いです。

例えば

・フィッシングメール → 高精度な文章生成だけでOK

・パスワード攻撃 → 自動化ツールで十分

・脆弱性探索 → 既存ツール+AI補助で可能

つまり「ミュトス級でなくても脅威になる」。

既に公開されているAIツールで成立しているサイバー攻撃もあります。

じゃあやっぱりAIは危険なのか?

ここは冷静に見る必要があります。

“即終わるレベルの危険”ではないが、確実にリスクは上がっているということです。

理由は以下です。

攻撃の「コスト」が下がる

→ 今まで専門家しかできなかったことが一般人でも可能になっている

攻撃の「規模」が増える

→ 1人で数千・数万件の攻撃が可能になる

攻撃の「質」が上がる

→ 見破りにくい文章・手法になる

重要な視点

重要な視点は、「特定のAIを止めても問題は解決しない」ということ。

本当の構造はこうです。

・AI技術は拡散する

・誰でも使えるようになる

・悪用する人は必ず出る

だから問題は「AIそのもの」ではなく「どう防ぐか」にシフトしています。

ミュトスのような高度AIが厳しく管理されているとしても、それだけで安全とは言えません。

なぜなら、現在はオープンソースAIや一般向けAIでも、一定レベルの攻撃を成立させることが可能になっているからです。

重要なのは「特定のAIを規制すること」ではなく、

AIが誰でも使える前提で、どう防御するかです。

これからの時代は、

「危険なAIを止める」ではなく

「AIによる攻撃を前提にした防御」が求められていきます。

そのためAIで攻撃されるのなら、AIで防御する、という話になっていきます。

AIが瞬間かつ無尽蔵で大量に物量攻撃してくるのに、人間側が手作業で1つずつ対抗しているのでは、とても間に合いませんから。

何百機もの戦闘機がガトリングガンで空から一斉射撃してくるのに、人間が地上で竹やりで応戦するのでは、とても勝てないのと同じです。

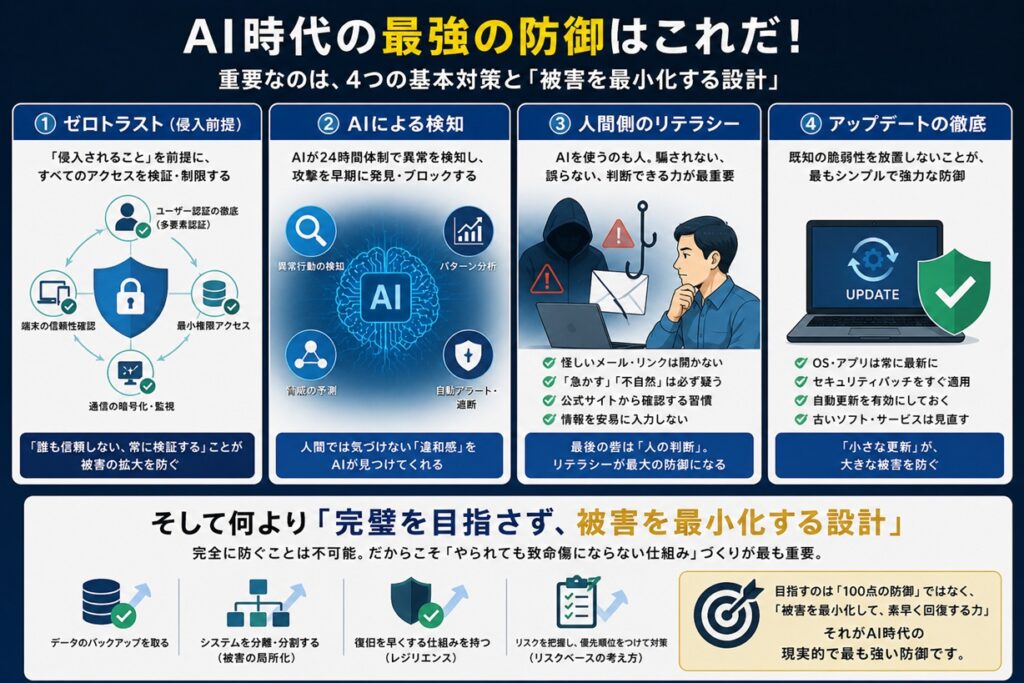

■ 「AIによる攻撃を前提にした防御」とは何か

これからの時代は、

「攻撃されないようにする」のではなく、

「攻撃される前提で被害を最小化する」考え方が重要になります。

なぜなら、AIによって攻撃のコストが大幅に下がり、

「完全に防ぐ」ことが現実的ではなくなっているからです。

そのため、防御の考え方は次の3つに変わっていきます。

① 侵入されても被害を広げない

従来は「外部からの侵入を防ぐ」ことが中心でした。

しかし今は、「侵入される可能性は常にある」前提で設計します。

具体的には

・ログインごとに本人確認(多要素認証)

・端末ごとにアクセス制限

・社内でも権限を細かく分ける

これにより、仮に一部が突破されても

被害が全体に広がるのを防ぐことができます。

② AIで“AIの攻撃”を検知する

攻撃が自動化されるなら、防御も自動化する必要があります。

すでに企業レベルでは

・異常なログインパターンの検知

・普段と違う操作の検出

・不審な通信のリアルタイム分析

などをAIが常時監視しています。

ポイントは「人間では気づけない違和感」をAIが見つけること

例えば、

「いつもと同じID・パスワードなのに、行動パターンが違う」

といったケースも検知できます。

③ 人間を狙った攻撃への対策

実は一番狙われるのは「システム」ではなく“人間”です。

AIによってフィッシング詐欺や偽メールは、

ほぼ見分けがつかないレベルまで進化しています。

そのため重要なのは

・リンクは即クリックしない

・「急かす内容」は一度疑う

・公式サイトから確認する習慣

“判断ルールを固定する”ことが重要です。

(例:「メールのリンクは絶対に踏まない」など)

④ アップデート

地味ですが、最も効果が高いのがこれです。

・OSのアップデート

・アプリの更新

・セキュリティパッチの適用

これは「既知の弱点を潰す作業」です。

AI攻撃の多くは、

「すでに知られている穴」を突いてきます。

つまり、更新しているだけで、防げる攻撃は非常に多いということです。

⑤ 個人でもできる“被害最小化”の考え方

完全防御が難しい以上、「やられても致命傷にならない設計」が重要です。

具体例

・パスワードの使い回しをやめる

・重要データはバックアップを取る

・クレカや銀行は通知ONにする

・サブ端末やサブアカウントを使い分ける

これにより、仮に1つ破られても

被害を局所化できる

■ AI攻撃からの防御法

これからのセキュリティは、

「守り切る」時代から「侵入されても崩れない設計」に変わっています。

AIによって攻撃は確実に進化していますが、

同時に防御の考え方も進化しています。

重要なのは、

・ゼロトラスト(侵入前提)

・AIによる検知

・人間側のリテラシー

・アップデートの徹底

そして何より「完璧を目指さず、被害を最小化する設計」

これが、AI時代の現実的で最も強い防御です。

今後の世界はどうなる?

現実的な未来は次のような感じでしょうか。

▶ 超短期(〜1年)

→すでに起きている

- 詐欺の高度化(AI音声・AI文章)

- サイバー攻撃の自動化が進行

▶ 短期(1〜3年)

→一気に変わるゾーン

- AIによる攻撃ツールが普及

- 企業は「AI前提の防御」に移行

- 個人でも被害の差が広がる

ここ半年の進化スピードを見る限り、AIは「直線的」ではなく「指数関数的」に進化していて、3〜5年という短期間で社会構造そのものが変わる可能性も十分にあります。

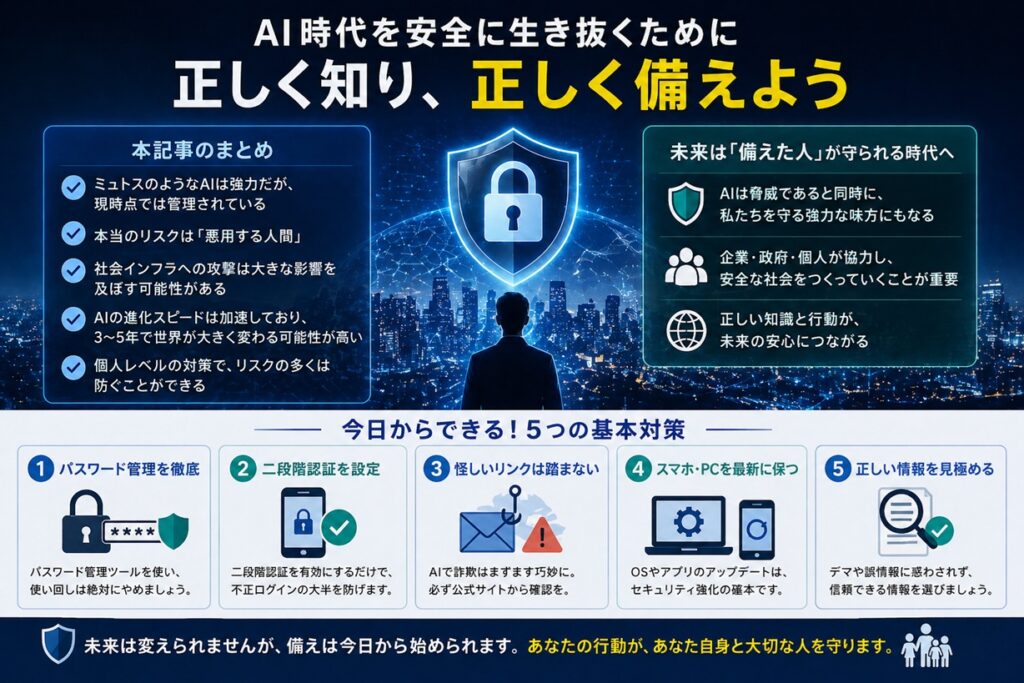

個人レベルで今すぐできる対策

ここが一番重要です。

AIが進化しても、個人ができる対策でリスクを防止に努めましょう。

① パスワード管理を徹底する

おすすめはパスワード管理ツール

- Bitwarden

1Password

→使い回しは絶対NG

② 二段階認証を必ず設定

- Google Authenticator

- Microsoft Authenticator

→不正ログインを防止

③ 怪しいリンクは踏まない

AIの進化で詐欺メールは見分けがつきません。

例えば、

「Amazonからの重要なお知らせ」

のようなメールも、本物そっくりに作られます。

→必ず公式サイトから確認する習慣を

④ スマホは最新機種+最新OS

スマホの安全性は、アップデート期間で決まる

■ まとめ

ミュトスのようなAIは確かに強力です。

しかし重要なのは、「危険かどうか」ではなく「どう備えるか」

✔ このページのポイント

- ミュトスは高性能だが(今のところ)管理されている

- 本当のリスクは悪用

- 個人でも防げるような対策をしよう

■ 最後に

これからの時代は「AI vs AI」の時代。

だからこそ私たちは、狙われにくい環境を作ることが最重要です。

コメント